Esta entrada fue escrita originalmente en Noviembre de 2024 y posteriormente revisada en Enero de 2026 (donde se indique).

Introducción

Hace un par de meses había guardado en mis bookmarks un episodio de un podcast que sirve para asesorar a la gente sobre el mundo de la autoría y los derechos de propiedad intelectual. A decir verdad no es un tema que particularmente me interese a pesar de mi intención de crear obras, pues considero que en mi caso las Creative Commons bastan y sobran (aunque a mediano plazo sí resultaría conveniente indagar del tema); pero este capítulo en particular tenía a una invitada que daba cabida a una discusión que, aparentemente todo dibujante de Twitter gusta de hacer escándalo cada cierto tiempo para llamar la atención, huir a otra red social temporalmente hasta que se les olvida y posteriormente volver a hacer lo de siempre: la creación y la IA.

Desafortunadamente se puede notar dentro de ese audio un bias evidente ante el tema de la IA dentro de los procesos creativos, y parece que medio Internet está deacuerdo de una u otra forma sin siquiera ponerse a plantear sobre las matices, los puntos grises y posibles ventajas que su uso podría otorgar. Yo no sería capaz de hablar (en ese caso) desde la perspectiva artística (aunque planeo hacerlo en otro ensayo), pero sí desde una ingenieril, pues en mi rama es común que hagan la separación entre la idea de que la IA es una herramienta útil para programar, pero que no reemplazaría (o muy difícilmente lo haría) la tarea de desarrollar; ya que la primera involucra solamente escritura de código, mientras la segunda es un conjunto de procesos que engloban no nada más esto último, sino desde el planteamiento, el diseño, el código, e incluso la presentación, mantenimiento y soporte, hasta la interacción que, si alguno nunca ha tenido que tratar con clientes, no entendería que es prácticamente difícil que una IA comprenda al 100% a una persona si luego ni siquiera las mismas personas se entienden a sí mismas.

Y con esto quiero creer que el involucramiento de la IA dentro de las tareas artísticas y creativas es básicamente lo mismo. Como lo mencioné, este es un tema que quisiera dedicar en otra ocasión, pero lo que quiero resaltar sobre todo es en algo que verdaderamente se tiene que discutir si queremos tener un cierto control en el tratamiento de contenido creado o asistido por IA: ¿Cómo identificarlos y para qué nos serviría?

Actualización 2026: Sobre la IA como herramienta

Bien se puede notar que en ese entonces tenía la insistencia de la IA como herramienta a pesar de que se veían los problemas sobre los modelos generativos. Pues en este periodo es cuando puedo decir que sigo sosteniendo el uso de esta como una herramienta, pero la parte que todos estos pelmazos no quieren entender es que no puede ser el medio, sino un apoyo; usarla para hacer drafts de forma rápida, para asistencia puntual, para revisiones o para correcciones particulares mas no para sustituir a un equipo completo. Tu techbro no lo entenderá porque no le importa más que hacerse las del lobo de Wall Street, pero quienes tienen los pies bien puestos en tierra sabrán que ese no es el camino que se debe buscar ni anhelar por más ahorros en costes y beneficios que parezca estar dando.

Amazon es capaz de despedir a miles de trabajadores en tiempo récord porque sus dueños son carentes de alma y con o sin IA lo harían una y mil veces más para reflejar ganancias en sus compañías; lo que tienen [con esta última] es una justificación para abrir más la brecha y darnos la idea de que no valemos ni un peso mientras tu típico “apasionado de la tecnología” le besa los pies e intentando imitarlos sigue el discurso de que la gente igual es reemplazable y toda la palabrería estetizada que le sigue.

De todas formas estoy consciente de que todos quieren elegir un bando y atacarse entre si antes de ver las áreas grises. Lo entiendo, después de todo somos seres que minimizan las posibilidades al absurdo + 1 (que en la mayoría de ocasiones se resume en un sistema binario donde uno es bueno y el otro el malo). Prueba de que no hay nadie benigno es ver cómo aquellos techbros se la pasan publicitando en redes sociales con todo el descaro del mundo productos generados con IA insistiendo que con 200 dólares pueden hacer publicidades o incluso cortometrajes que a un estudio le costaría miles, ignorando todos los defectos que los propios modelos generativos no pueden evitar, como lo es alucinar o no tener consistencia -este último problema siendo uno que parece intentan arreglar pero por la excesiva demanda computacional que requiere no creo que se solvente a corto plazo-.

Pero por otro lado tienes a los descerebrados que nada más por oir la palabra “IA” se enojan y atacan sin pensarlo dos veces a todo aquel que lo haya usado por cualquier motivo por más nimio que parezca. Eso le sucedió al equipo de desarrollo de Expedition 33, el cuál se le acusó indebidamente de uso de modelos generativos sin indagar en qué, pues al poco rato la información se propagó como la espuma y todos absolutamente se quejaron e insultaron al estudio. Al final resultó que sí habían usado dichas herramientas, pero eran assets de prueba que posteriormente iban a eliminarse.

¿Al final podemos saber qué ocasiona esto? Pues que las compañías y equipos de trabajo usen en mayor o menor medida contenido generado por IA, pero para evitar problemas prefieran evitar ser transparentes y opten por no decir la verdad, pudiendo afectar a todos pues ¿Cómo sabremos al final que algo fue o no hecho con IA si nadie quiere desvelarse? Muchos podrían mentir diciendo que fue 100% humano, pero no habría forma contundente de demostrarlo. Ese es el motivo de por qué los “sellos IA” deberían de promoverse, pero con matices y objetividad (cosa que veremos a continuación).

¿Por qué marcar contenido creado o asistido por IA?

Muchos cavernícolas anti-IA dirían instintivamente que ‘es más que obvio: para evitarlo’; pero este no es el caso. La cuestión aquí es que la creación de marcas que indiquen si un contenido fue tan siquiera asistido o creado completamente por IA será de gran ayuda en el futuro por tres casos posibles:

-

Está bien establecido que es mala idea que una IA se retroalimente por otra IA, pues puede generar sesgos que podrían confirmar falacias que personas puedan utilizar. Esto se ha dado en demasiadas ocasiones, pero puedo citar casos personales donde, siendo en ese entonces estudiante universitario, llegué a notar cómo compañeros habían pegado información falsa dentro de escritos. Siguiendo el hilo: si una fuente fue creada por una IA sin indicarlo y ésta alucinó información que no es verídica, otra IA podría alimentarse de ello y, mágicamente, ahora hay fuentes que validan dicho dato apócrifo.

-

Hasta este punto parece que muchos hijos de Einstein se han dado cuenta de que la IA no es realmente tan inteligente como parece, pues básicamente es un promedio de todo el contenido generado a lo largo del tiempo. Aquí la cuestión es que esta herramienta es muy útil en tareas como búsquedas y manejo de grandes cantidades de datos; pero para determinación de conclusiones y, en general, para escritos verídicos y que necesitan comprobación no terminan de funcionar e incluso pueden generar desinformación.

-

La tercera es, simplemente, transparencia. Es confiable que el autor indique si su obra utiliza de una u otra forma una herramienta tal como IA para que otras personas no desconfíen de lo que hace o dice. Lastimosamente este punto es demasiado complicado de solventar pues todos los imbéciles atacan a aquel que lo usa sin importar la condición o motivo, alentando que básicamente se esté utilizando de toda forma imaginable, pero la gente prefiera no decirlo por temor a repesalias. Al final resulta ser que los ‘chicos listos anti-IA’ son otro problema más que una solución.

Actualización 2026: Posibles erratas

En aquel entonces el que las IA se estuvieran auto-alimentando con su propio contenido se consideraba problemático, pero la propia OpenAI declaraba que era una problemática que tenían resuelta, pues indicaban que su empresa poseía una herramienta que ayudaba a detectar contenido generado por su propio chat y evitara así introducir datos auto-generados para retroalimentar los modelos. Claramente se supone que no es explícito sino que podría ser metadatos, marcas de agua sutiles o invisibles al ojo humano en las imágenes y demás material creado. Aun así, mi pregunta es ¿Podemos creer que está mitigado el problema? ¿Cuándo algo deja de tener dicha marca: si lo modifico parcial o totalmente; si lo transcribo; si únicamente lo tomo como referencia? Este último caso es interesante pues podemos decir que la creación puede pasar a apropiarse pero la base no fue una creación humana sino un copia y pega de lo creado por esta, y sigue teniendo el problema de ser contenido con el que se está retroalimentando.

Igual puede que haya sido algo condescendiente llamando ‘cavernícolas’ a aquellos que se oponen a la IA, recordemos que en 2024 lo veía como una herramienta viable de usar; en la actualidad también lo sigo viendo de dicha forma pero con las importantes matices de que todos los modelos que usamos son cerrados -o sea que se supone son en pos de la humanidad y en vez de hacerlos de código abierto prefieren lucrar con ellos- y en vez de centrarse en usarse para cosas importantes y donde se deberían estar usando (datos masivos, medicina, investigación, etc), prefieren malgastar cantidades ingentes de energía y poder de cómputo para hacer videos horrendos y dibujos ráncios.

Las propuestas para solventar el problema

Nuevamente, es algo que yo personalmente vería como bueno, de no ser porque usar este tipo de sellos son más como una marca para que gente te ataque sin sentido y demerite no nada más tu trabajo, sino tu persona. Pero al menos uno de los dos casos me parecen interesantes:

not by AI

Este es un sello, creado por la organización de mismo nombre, que busca marcar aquellas obras de todo tipo que han sido creadas al menos en un 90% por una persona. Su motivación es la misma premisa que suele hacer que también los IA-bros sean considerados una burla: depender únicamente de IA fomentaría a la inexistencia de creaciones bajo las que las propias Inteligencias se alimentan, por lo que este es un movimiento más planteado para motivar a las personas a demostrar que su creación aún vale.

A diferencia de lo que puede parecer, este es un distintivo que se busca usar para que se evite el problema mencionado sobre permitir que IA’s se retroalimenten de otras IA’s, siendo en este caso de forma más indirecta que directa.

Para todo aquel interesado en tener dicha insignia, la puede obtener de dos formas: la primera es para uso personal, donde el autor paga de manera voluntaria la cantidad que desee por estas y se les haga llegar por su correo; mientras que para uso comercial se tiene que hacer un registro tanto de cuenta como de obra, llenar un formato y esperar la verificación de los administradores, y posteriormente poder utilizar el sello, aunque menciono nuevamente, para uso comercial.

Y poco más creo que puedo decir. Realmente no lo vería como una propuesta negativa de no ser por que es excluyente en el mal sentido; siendo entonces que su único enfoque es unidireccional para indicar que la creación es genuinamente humana. Es entonces, en mi opinión personal, una etiqueta con la misma funcionalidad que aquellas etiquetas ‘eco-green’ y similares: no tienen la intención de ser informativas, sino mayormente como si se trataran de insignias por ser niños “educados, responsables y conscientes”.

Hasta su mismo diseño lo indica: la leyenda indicando que es una creación humana y, en grande la leyenda ‘Not by AI’, y su ícono una carita feliz… es evidente la intención inicial: una decoración para darle plusvalía a un trabajo.

SafeCreative AI

Este sello es el que considero mejor estructurado que el anterior, pues si NotByAI funcionaba más como una forma de publicidad, éste tiene una intención mayormente formal y sin un bias específico.

SafeCreative es una organización encargada del registro de marcas y obras por propiedad intelectual. Esto ya de base es una muestra de lo que busca este apartado, llamado ‘Declaración de creatividad’. Es su misma neutralidad su mayor fuerte, pues la idea es que funcione de la misma forma que los indicadores de información nutrimental de los alimentos. Para muestra de ello, su modo de funcionamiento:

La Declaración de Creatividad tiene un modo de funcionamiento similar a las Creative Commons: tiene dos categorías clave para la identificación del tipo de obra que se está marcando, sin ningún tipo de especificidad, y sin embargo siendo lo más completa al dar en el clavo en los elementos fundamentales a resaltar al momento de hablar sobre obras creadas o asistidas por AI:

-

‘¿Cómo ha sido tu proceso creativo?’: Este apartado busca indagar sobre cómo influyó el uso de IA en la obra a registrar; siendo sustentada en cuatro niveles:

-

La persona no quiere mencionarlo.

-

La persona hizo toda o casi toda la obra: desde la idea y concepción hasta la finalización.

-

La persona tuvo nula o ínfima intervención en la creación de la obra, siendo que la IA desarrolló la mayor parte del trabajo, aún si las ‘instrucciones iniciales’ fueron de la primera.

-

La persona utilizó IA únicamente para hacer correcciones, modificaciones, mejoras o incluso la creación de algunas secciones, pero no es un trabajo puramente hecho con ésta.

-

-

‘¿Qué tipo de contenido tiene la obra?’: Sirve para que se indique el tipo de trabajo que se está registrando; es decir, si se debe de tomar como una creación ficticia o un trabajo basado en hechos. Este apartado me es un tanto particular, sobre todo por las descripciones de los casos:

-

La persona no quiere mencionarlo.

-

La obra refleja de alguna forma un hecho o la realidad en general, pero aún añadiendo toques ficticios para mejorar la calidad artística. Este caso ya especifica de base que las obras a registrar no pueden ser como tal papers ni proyectos, sino mayormente aquello que abarca derechos de autor: cosas basadas en ideas, tengan o no fundamento en datos y hechos.

-

La obra no refleja un hecho o la realidad, sino que gran parte de ésta es inventada (ficción).

-

Es una propuesta interesante, además que ayuda muchísimo a que se identifique concretamente casos intermedios como aquellos que solemos utilizar estas herramientas para asistencia en mayor medida. De momento no he visto su aplicación en entornos reales, pero viendo que no se pueden utilizar en apartados como papers científicos, entiendo por qué no es tan usada.

Y podría ser la herramienta definitiva, de no ser que tiene el mismo problema que NotByAI: sólamente está disponible sin costo para uso personal, pero si se quiere usar con fines comerciales uno tiene que registrar su obra con esta empresa y posteriormente aplicar para la marca de Declaración de Creatividad. Igualmente en el podcast que inspiró este ensayo lo mencionaban: realmente muchos están viendo la oportunidad y monetizan con la incertidumbre de la autoría de una obra.

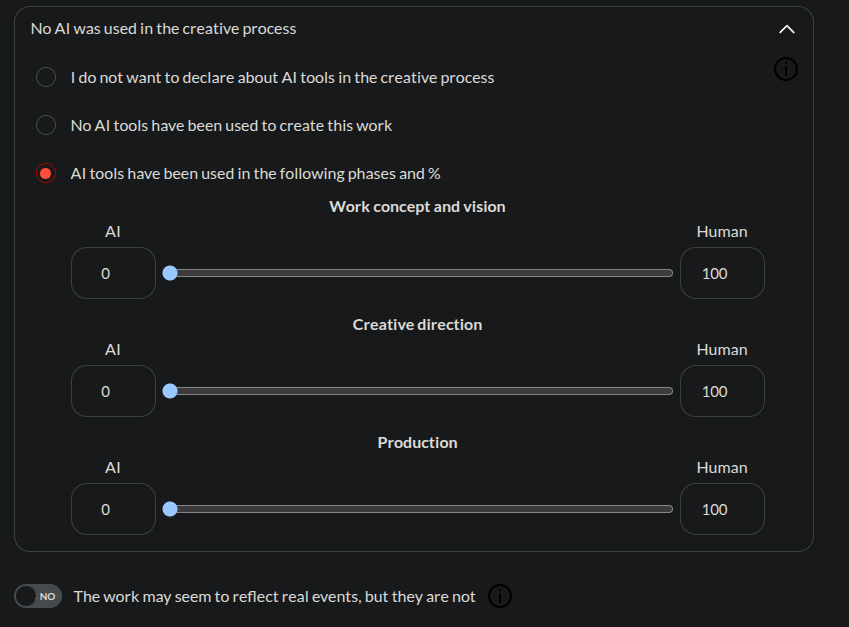

Actualización 2026: SafeCreative AI parece haber cambiado su funcionamiento

- Concepto y visión de la obra

- Dirección creativa

- Producción

Dichas opciones no aparecerán sino si en un marcador previo indica directamente que una obra utilizó apoyo de IA en determinados porcentajes. Las otras opciones son ‘no quiero declarar’ y ‘no se usó IA’.

Esto a diferencia de como funcionaba su anterior esquema me parece más escueto, pues alguien despistado podrá no entender la diferencia entre alguna de las tres opciones, además que usar porcentajes no ayuda de mucho, pues ¿Qué diferencia que haya usado un 50% de IA y no un 60%? ¿O si usé un 65% en vez de 64%?. Me apena un poco ver un sistema funcional verse afectado por una decisión así de inestable para calificar el uso de este tipo de herramientas.

¿Son necesarias?

Para no alargar el ensayo más de lo que debe, lo diré de manera directa: Si.

Si no existe regulación en el tema, no nada más sufrirán las herramientas de IA al momento de estar colapsando gracias a su feedback indirecto; sino que los mismos usuarios serán los afectados pues gran parte de los sistemas que se usan hoy en día están siendo alimentados por IA, por lo que si vemos cosas como gente extremista, alucines o recomendaciones inútiles de contenido basura, si no se hace algo al respecto entonces tendremos el doble o más de contenido disfuncional.

Pero viendo que dichas herramientas de etiquetado son mayormente propietarias, entonces dudo que exista algo positivo que se pueda hacer al respecto al menos en el mediano plazo. Bien es cierto que existen ya propuestas de ley a lo largo del mundo para que se limite de alguna forma esta herramienta (aunque igual todos bajo un sesgo a favor o en contra), pero la exigencia de una herramienta gratuita pero obligatoria para creatividad no sería mala idea… o al menos que funcione de manera similar a las Creative Commons.

Es más, yo propondría que sean las Creative Commons las que se encarguen de crear un tercer apartado que se encargue de determinar el proceso creativo/marcar la cantidad de uso por IA. Que funcione de manera similar a la marca de SafeCreative pero con las mismas libertades que proporcionan las CC. Bien es cierto que éstas no se dedican a determinar procesos creativos sino las condiciones de uso de la obra, pero sólo veo viable este caso o crear una organización similar (es decir, sin fines de lucro) dedicada a la gestión de licencias creativas.

Ahora, una disputa podría ser que esto le quite parte de la privacidad al usuario, pues al tener que declarar el proceso creativo de una obra le podría quitar esa confidencialidad y confianza que se posee. No es un tema que me interese pues siendo un escenario hipotético-exploratorio no se podría sustraer mucho, pero en general no propongo que sea una marca para controlar la distribución, sino mayormente para catalogar obras y se eviten males mayores a futuro. Posiblemente las empresas ya estén trabajando con la finalidad de evitar los problemas que mencioné sobre manejo de datasets (y de hecho las grandes tecnológicas ya están solucionando el problema, por lo que la incógnita se está reduciendo), pero viendo ambas propuestas me parece que están apuntando hacia la dirección correcta, aún siendo mayormente tablas informativas.

Actualización 2026: Mi propuesta

Viendo que la situación está cada vez peor y que no se hará nada al respecto, decidí hacerle de abogado y proponer una idea que podría llegar a ser igual de funcional que SafeCreative pero con una mayor flexibilidad, abarcando los que considero los cinco puntos fundamentales que abarca la producción de una obra independientemente de su tipo.

Funcionamiento

Empezamos con una pregunta en concreto: ¿La obra es una creación ficticia?. En caso de que sí, entonces se catalogaría como paper/ensayo/investigación o derivados, de otra forma entonces sería una creación creativa.

Después, la siguiente cuestión surge: ¿En qué parte fue utilizada la IA?. La respuesta sería difícil, pero el creador podrá marcar una o más opciones de entre las cinco categorías que existen:

-

Si es paper/ensayo/investigación

-

Generación de ideas

-

Formulación e hipótesis

-

Análisis o redacción

-

Investigación o fuentes

-

Corrección integral

-

-

Si es creación creativa:

-

Generación de ideas

-

Concepto (apoyo visual o esquema)

-

Proceso de desarrollo o trabajo creativo

-

Proceso de investigación

-

Corrección integral

-

Finalmente, el último paso es determinar en su integridad (o en su defecto para aquellas categorías que el usuario haya seleccionado anteriormente) cuál fue el nivel de uso de la Inteligencia Artificial. No representado por porcentajes pues puede haber conflictos en lo que el usuario entienda por valores numéricos, sino entonces por frases que describan su situación. Para ambos casos sus niveles serían:

-

Nulo: La persona hizo el trabajo con la intención de no usar ninguna herramienta de IA

-

Parcial-1: La persona utilizó alguna herramienta de IA de forma mínima, a modo de asistente en tareas que no alteran o alteran muy poco el trabajo base.

-

Parcial-2: La persona utilizó alguna herramienta de IA de forma moderada, haciendo alguna revisión, alteración o creación de contenido específico o puntual.

-

Total-1: La persona utilizó alguna herramienta de IA de forma total, pero alterando el contenido generado totalmente

-

Total-2: La persona utilizó alguna herramienta de IA de forma total, pero alterando el contenido generado parcialmente

-

Total-3: La persona utilizó alguna herramienta de IA de forma total, generando el contenido de manera completa y sin ninguna intervención humana más allá de la solicitud.

Acto seguido se daría un código de catálogo o archivo para anexar en su registro (como lo que hacen las Creative Commons) seguido de un sello o estampado por si el usuario desea anexarlo en su obra (nuevamente, como lo que hacen las Creative Commons). Este último punto no lo desarrollé por falta de tiempo, pero capaz me atrevo y genero el servicio web y hasta las etiquetas por si algún loquito le ve potencial y usabilidad.

Conclusiones

La necesidad de determinar si un trabajo fue creado entera o parcialmente por medio de una Inteligencia Artificial no es solamente un capricho ni un instrumento para promover la persecusión de autores que la usen o que incluso forma parte importante de su proceso, sino una forma para evitar posibles deficiencias en los sistemas que asisten nuestra vida aunque no lo parezca: desde el consumo de media en redes sociales, así como temas más serios como notas o papers científicos.

Es de esta forma que, dejando de lado legislaciones en proceso de revisión e implantación, se perciben formas de etiquetar las obras de esta índole bajo un sello que indique su uso o participación dentro de la obra. Siendo una mayormente un sello de confirmación, mientras la otra una herramienta completamente expositiva e informativa. Ambas poseen puntos a favor y en contra, siendo mayormente su índole comercial, pero funcionando para casos de uso personal.

Referencias:

Fernández, M. (2024, October 14). “El colapso del modelo”: por qué la IA puede explotar por sí misma (y sería muy difícil de evitar). Infobae.

Lizana, J. A. (2023, June 14). Los expertos avisan que la IA puede terminar colapsando: sus datos están siendo contaminados por otras IA. Genbeta.

Polo, J. D. (2024, April 15). Entrenando modelos de IA con datos generados con IA, peligros y posibilidades. WWWhatsnew.

LeGardon. (2024, September 16). 109 Declaraciones de creatividad: «Hecho 100% sin IA». LeGardon | Artsesoría.

Not By AI. (n.d.). Tu contenido libre de IA se merece una Insignia. Not By AI. Retrieved January 29, 2026.

Safe Creative. (n.d.). Declaración de creatividad. Safe Creative. Retrieved November, 2024.

Safe Creative. (n.d.). Register express. Safe Creative. Retrieved January 29, 2026.

Alsina, G. (2024, September 11). OpenAI posee un detector de contenido generado por IA. Tecnonews.

Norton, B. (2025, December 22). Clair Obscur: Expedition 33 AI controversy explained: Dev comments, awards rescinded, more. Dexerto.

Esta obra procuró no usar IA salvo para el formato de las fuentes

y fue un dolor de cabeza, más conveniente era hacerlo uno mismo

Esta obra está bajo una Licencia Creative Commons Atribución-NoComercial 4.0 Internacional.